сгорела нода из 2020 года

2 дня назад она типо зависла — я нашел ее отключенной

включил через power

но т.к. в hetzner часто серверы зависают — не придал значения

а сегодня опять чел пишет тикет — вдс не работает

смотрю опять лежит

ребутаю — хуй там

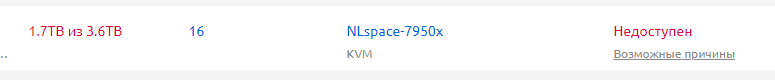

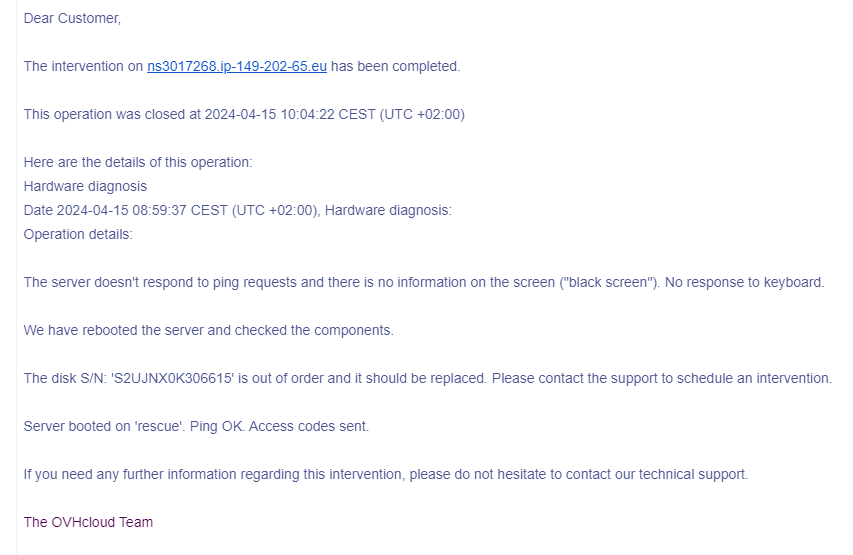

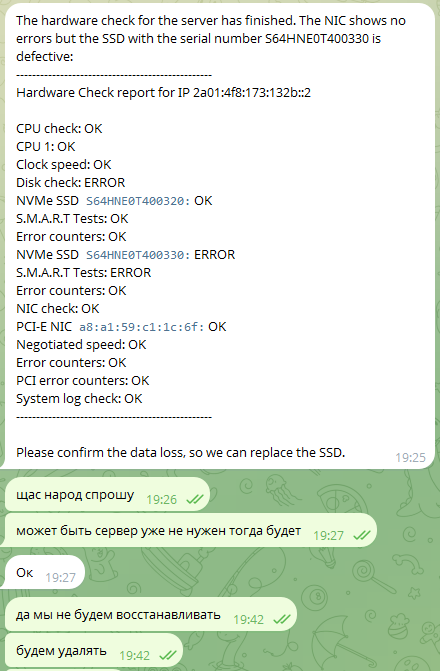

потом списываемся с ДЦ — оказывается диск сгорел

один из двух

но т.к. мы используем raid0 как я уже писал

то ФС утеряна

конечно тут моя вина как хостера, что я специально делаю еще хуже чем просто «сгореть» — raid0 это 100% исход сгораний

но зато клиент получает свои 400 ГБ NVME

короче сгорания у нас не часто случаются

и мы их все документируем

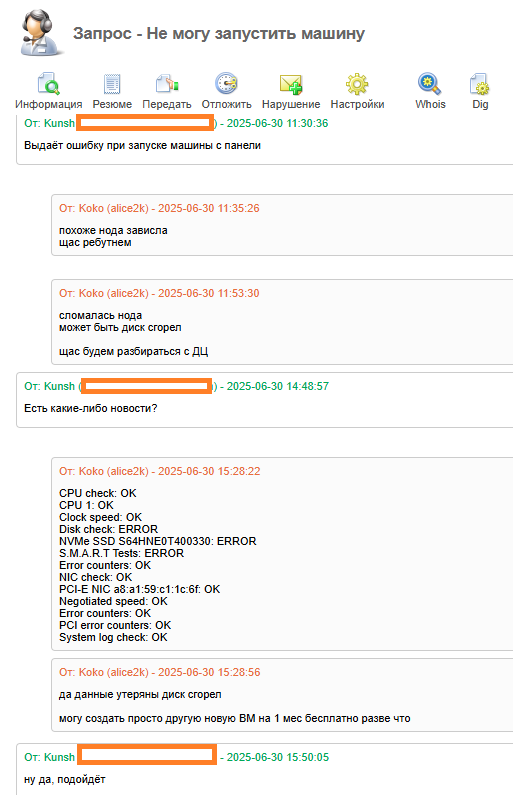

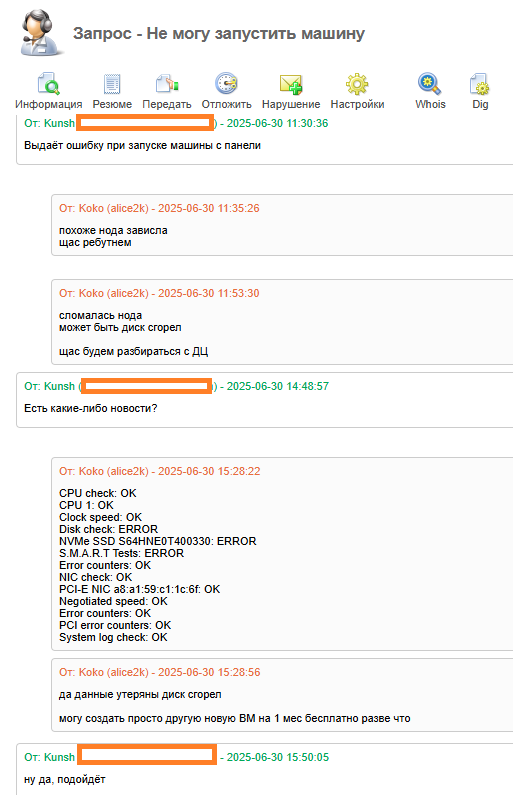

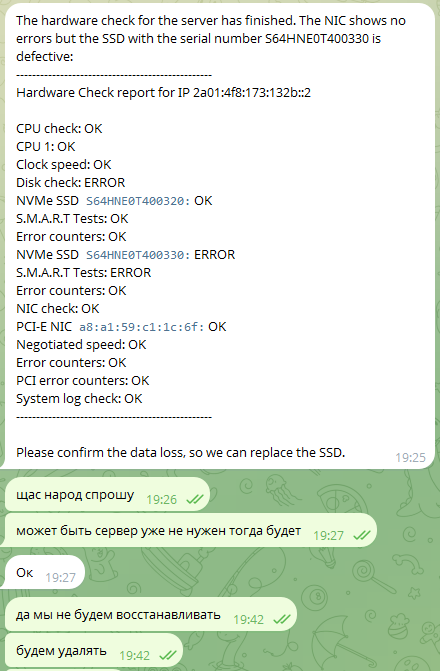

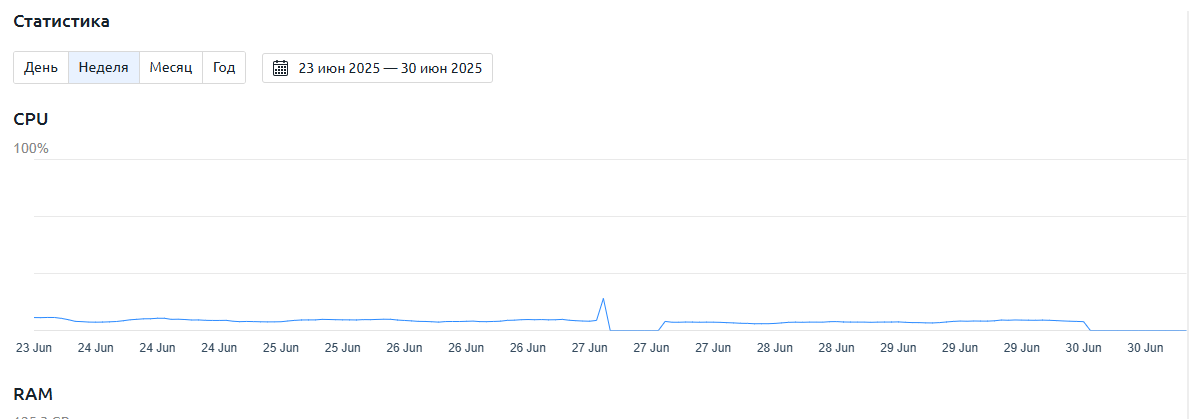

итак как выглядит сгорание?

вот так

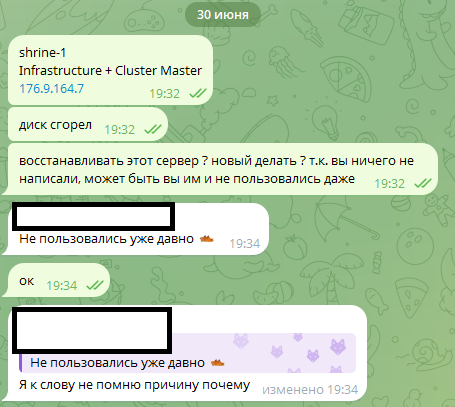

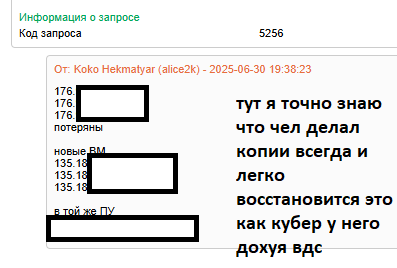

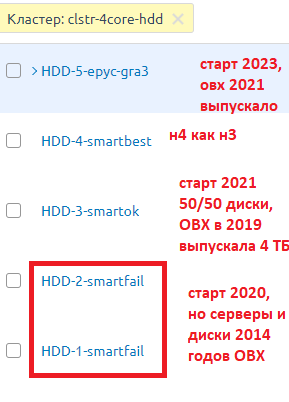

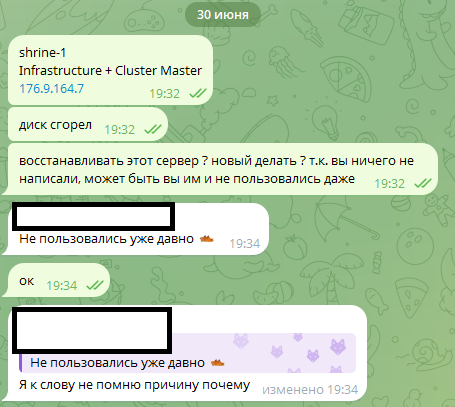

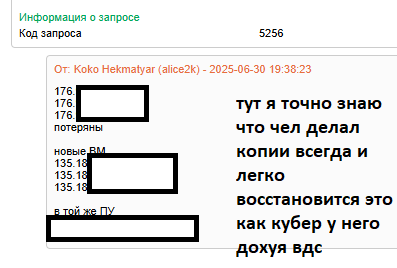

итак как выглядит сгорание для репутации?

вот так

включил через power

но т.к. в hetzner часто серверы зависают — не придал значения

а сегодня опять чел пишет тикет — вдс не работает

смотрю опять лежит

ребутаю — хуй там

потом списываемся с ДЦ — оказывается диск сгорел

один из двух

но т.к. мы используем raid0 как я уже писал

то ФС утеряна

конечно тут моя вина как хостера, что я специально делаю еще хуже чем просто «сгореть» — raid0 это 100% исход сгораний

но зато клиент получает свои 400 ГБ NVME

короче сгорания у нас не часто случаются

и мы их все документируем

итак как выглядит сгорание?

вот так

итак как выглядит сгорание для репутации?

вот так