msk.Ryzen9-7950X-192ram [noda64] [ponaehali.moscow]

- Историю и пример, как анонисировать ноды можно почитать

- Правила портала VM.center

- Добавлено на узел cloud.russia.network/

- Добавлена в честную Историю — list.skladchik.ovh (2024 год узлы смотреть)

- А так же добавлено в мониторинг.

- Конкретно эта нода stats.uptimerobot.com/qT5QJJLhnj/797030609

Итак, добавлена noda64 [m9]

IP — 24 штук.

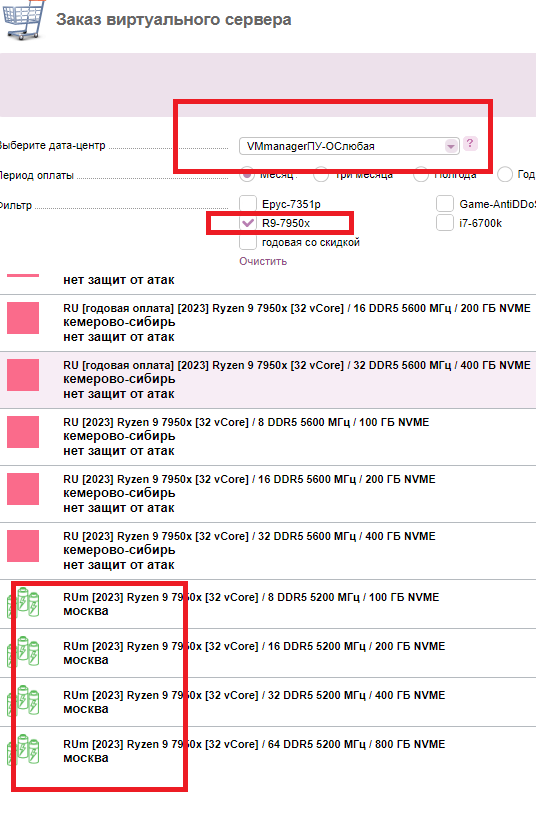

Доля/Тариф на 1 долю (можно соединять)

- Ryzen9-7950X [32vCore] / 8 ddr5 / 100 ГБ NVME / 1 IP

- Старт 06-2024 год — цена 1000р

- С 06-2025 цена — далее 1000р (так как больше нету понятия «вечная лицензия и с второго года уже не дешевле»)

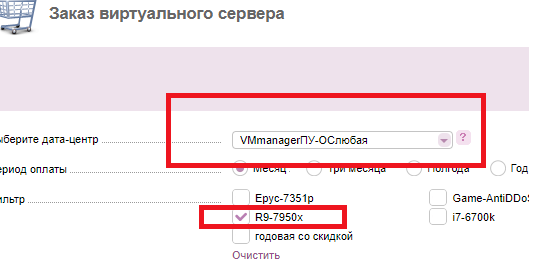

Автоматически можно заказать

Биллинг панели где доступно

666.ponaehali.moscow

bill.yacolo.net/billmgr

panel.skladchik.ovh/billmgr

asuka.onl/billmgr

На этом проекте поддержки нет. Но у других хостеров на портале vm.center — будет, но и цены там будут другие и анонсы тоже ;)